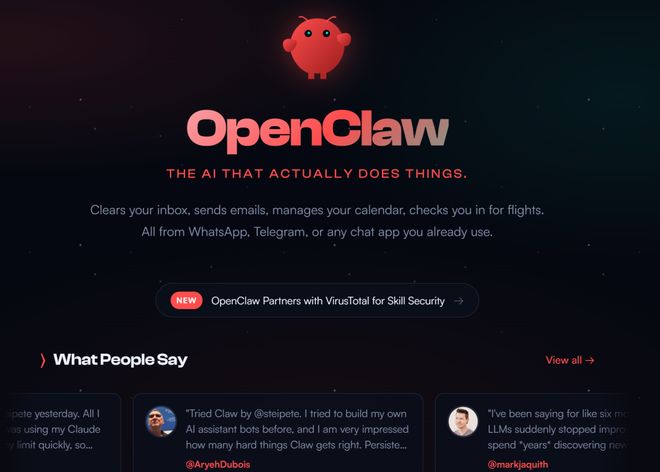

OpenClaw核心功能详解:自动化数据抓取与智能处理的强大工具

在当今数据驱动的时代,高效获取和处理网络信息已成为企业和研究者的核心竞争力。OpenClaw作为一款强大的开源网络爬虫框架,正为此需求提供了卓越的解决方案。它究竟能做什么?简单来说,OpenClaw是一个设计用于自动化、高效且可扩展地从互联网上抓取、解析和存储结构化数据的工具库。

OpenClaw的核心功能首先体现在其强大的数据抓取能力上。它能够模拟浏览器行为,轻松应对各种复杂的网页结构,包括那些依赖JavaScript动态加载的内容。用户可以通过简洁的配置,定义需要抓取的网站目标、爬行路径以及数据提取规则。无论是电商网站的产品信息、新闻媒体的文章内容,还是社交媒体上的公开数据,OpenClaw都能稳定、持续地进行采集,将散落在网络各处的非结构化信息,转化为整齐可用的结构化数据。

其次,OpenClaw在智能解析与处理方面表现出色。它内置了丰富的解析器,支持HTML、XML、JSON等多种格式,并允许用户使用XPath、CSS选择器或正则表达式等灵活方式精确提取目标字段。更值得一提的是,其框架设计支持中间件和管道处理,这意味着开发者可以轻松集成数据清洗、去重、格式转换乃至初步的文本分析功能,实现从“采集”到“可用”的一站式流水线作业,极大地提升了数据准备的效率。

此外,OpenClaw的分布式与可扩展性设计满足了大规模数据采集的需求。它支持分布式部署,能够协调多个爬虫节点同时工作,不仅加快了采集速度,也提高了系统的稳定性和容错能力。同时,其良好的架构设计使得开发者可以根据具体项目需求,扩展自定义的下载器、调度器或存储后端,例如将抓取结果直接存入MySQL、MongoDB数据库或写入Elasticsearch进行索引。

最后,OpenClaw注重爬取的合规性与效率管理。它提供了请求频率控制、随机延迟、用户代理轮换等机制,帮助使用者尊重目标网站的Robots协议,避免对目标服务器造成过大压力,从而实现友好、可持续的数据采集。这对于需要长期、定期更新数据的项目至关重要。

综上所述,OpenClaw远不止一个简单的网页下载工具。它是一个功能全面的网络数据获取与处理生态系统,从智能抓取、精准解析到高效存储与管理,为市场分析、竞品研究、学术数据收集、价格监控等多种应用场景提供了坚实的技术基础。通过利用OpenClaw,团队可以将宝贵的人力从繁琐重复的数据收集工作中解放出来,更专注于高价值的数据分析与业务洞察。